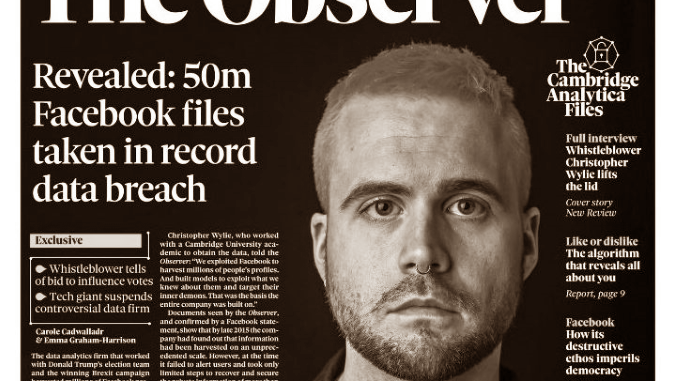

Recenti vicende hanno portato alla ribalta alcuni possibili tipi di utilizzo della grossa mole di dati che gli utenti dei “social” lasciano – più o meno consapevolmente – in rete.

Le cronache internazionali si sono concentrate, in particolare, sull’uso potenzialmente scorretto di un’enorme quantità di informazioni, nella disponibilità di Facebook, da parte di Cambridge Analytica, un’azienda di consulenza e per il marketing online. Questa società – fondata nel 2013 – è specializzata nell’attingere ai dati generati dagli utenti dei social network (ad esempio: quanti “Mi piace” mettono e su quali post, dove lasciano il maggior numero di commenti, il luogo da cui condividono i loro contenuti,…) al fine di sviluppare sistemi di “microtargeting comportamentale”. Le informazioni “grezze” raccolte sono infatti elaborate da modelli e algoritmi per creare profili di ogni singolo utente, con un approccio simile a quello della “psicometria”, il campo della psicologia che si occupa di misurare abilità, comportamenti e, più in generale, le caratteristiche della personalità.

A partire da queste notizie, abbiamo deciso di proporvi, a titolo di approfondimento in tema di Big Data, ampi stralci di un’intervista che Paolo Benanti, teologo ed esperto di tecno-etica dell’Università Gregoriana di Roma, ha recentemente concesso a Luigi Crimella, collaboratore della LUMSA.

Big Data sta per grandi numeri, una mole di informazioni nemmeno lontanamente concepibili da parte della singola mente umana, tutte stipate in enormi server e virtualmente a disposizione di chi le detiene. Si calcola che ogni minuto nel mondo vengano inviate oltre 200 milioni di e-mail, siano postati su Facebook 2,5 milioni di contenuti, siano caricati su YouTube oltre 70 ore di video e su Instagram si aggiungano 200 mila nuove immagini. Insomma un diluvio di “dati”. Che senso ha tutto questo?

È utile e logico trattenerli, organizzarli, studiarli, sezionarli, gestirli e … venderli? Lo abbiamo chiesto al prof. Paolo Benanti, docente di teologia morale fondamentale alla Pontificia Università Gregoriana di Roma dove tra l’altro tiene corsi di neuroetica (“le nuove sfide delle neuroscienze”), tecnoetica (“la persona all’incrocio di tecnologia, società e valori”) e un innovativo corso sul “postumano” (“considerazioni antropologiche e sfide etiche”).

La sensazione odierna, guardando allo sviluppo delle scienze empiriche, strumentali, informatiche, biotecnologiche, è che di fronte all’uomo non ci siano quasi più barriere insormontabili. È proprio così?

BENANTI – “Quando si ha a che fare con le tecnologie non si può scindere ciò che comprendiamo delle stesse tecnologia dall’etica. Per fare un esempio, si pensi a Nobel: vede la nitroglicerina e vede minatori che faticano e muoiono nei pericolosi lavori di scavo. La sua invenzione è di grande aiuto al lavoro in miniera, ma gli sviluppi sul Tnt giungono fino alle bombe nucleari, potenzialmente letali per una larga fetta di umanità. Davanti alle invenzioni e ai progressi, per molti versi strabilianti, delle scienze e delle tecnologie non possiamo quindi non porci la domanda su dove sia il senso e anche il ‘limite’, oltre il quale si rischia il regresso e il pericolo per l’uomo stesso”.

L’esempio di Nobel è un po’ estremo. In realtà, alcune scienze appaiono meno “esplosive”: penso agli studi sulle neuroscienze o all’informatica applicata. Dove stanno, in questi casi, i rischi?

BENANTI – “Da sempre l’uomo, in ogni suo passo in avanti, è posto di fronte alla questione del ‘limite’, nella duplice chiave interpretativa di ‘frontiera’ e di ‘forma’ nuova ed estesa che il progresso conferisce alla sua identità. Pensiamo alle scienze biotecnologiche connesse alle neuroscienze. È innegabile che si realizza una inserzione biologica dai molteplici rilievi e con ricadute a volte impreviste. Ad esempio, con la ‘deep brain stimulation’ che fa funzionare il cervello in maniera assolutamente diversa, la domanda è: cosa fanno, come reagiscono, ci sono delle conseguenze a breve o a lungo termine sulle persone sottoposte a questi trattamenti? Dagli studi più recenti emergerebbe che diverse persone coinvolte in tali esperimenti si percepiscano come persone ‘differenti’. In questo come in molti altri casi, bisognerebbe quindi chiedersi se non si è andati oltre il limite, cioè se la buona intenzione di studiare le risposte cerebrali a determinati stimoli non rischino di provocare problemi e reazioni sconosciute e ingovernabili. Per cui si torna alla questione del senso: le tecnologie possono ‘bucare la pelle’ dell’essere umano, pur rappresentando un ponte tra lo stesso essere e la macchina da lui inventata. Si collocano in questo incrocio le questioni del ‘postumano’, sulle quali oggi si inizia a cimentarsi da parte di diversi studiosi”.

Lei è uno studioso e uomo di Chiesa: le sembra che essa sia oggi preparata ad affrontare e interagire con il mondo che si profila sempre più connesso, high tech, immerso nei “dati” e globalizzato?

BENANTI – “La Chiesa ha una duplice natura: da un lato è il deposito della rivelazione di fede e dall’altro è anche una organizzazione strutturata di oltre 1 miliardo di uomini. In virtù di tale deposito è chiamata a dire qualcosa anche sul mondo delle tecnologie. Però sarebbe illusorio pensare che in ogni sua parte possa avere la stessa competenza nell’approccio ai nuovi ritrovati. È vero che l’occidente moderno sfrutta le tecnologie in molte direzioni, anche per evangelizzare. Prendiamo il caso dell’Africa, dove è più facile avere un cellulare che disporre di un bagno. Il 90 per cento dei libri letti in quel continente sono e-book e su piattaforme digitali. Per i presbiteri e i religiosi africani è comune avere le Bibbie, i testi teologici e pastorali in formato elettronico nello smartphone. Ve lo immaginate un missionario che raggiunge sperduti villaggi nella savana con i libri liturgici cartacei per la celebrazione della messa? Invece viaggia col suo tablet che li contiene tutti e che pesa solo un paio di etti. Nelle favelas di Lima centinaia di migliaia di persone vivono in baracche, ma tutte hanno internet. E che dire dell’influsso dei nuovi media sui paesi post-comunisti? Esiste quindi una pluralità di situazioni in cui gli uomini approcciano le nuove tecnologie e ne sono influenzati anche profondamente. E ciò vale anche per la Chiesa, senza alterare il suo messaggio”.

Quindi siamo abilitati a parlare di vero progresso grazie al diffondersi delle tecnologie digitali?

BENANTI – “Un dato è certo: si tratta di tecnologie veramente pervasive, che si espandono rapidamente. In Africa il bagno fa ancora fatica ad arrivare, ma lo smartphone si trova nelle località più impensate. E quando si vendono milioni di pezzi diretti in quel continente, la domanda è la seguente: è più urgente il bagno o le tecnologie digitali? Analogamente, se pensiamo agli studi sul cyborg, l’unione tra uomo e macchina, ci si è posta la questione della ‘fear of uncertainty’, cioè il timore dell’incerto: farà bene o farà male? La domanda etica, in questo caso, è generata dalla paura dell’ignoto e si fonda sul principio di precauzione. C’è anche la prospettiva di studi accademici basata sull’ ‘equality and pursuit of happiness’, secondo la quale l’etica non consiste nella persona in quanto tale ma nella relazione tra persone: una volta raggiunto l’accordo su alcune regole di civile convivenza (policy), tutto fila liscio e ognuno cerca la felicità come meglio ritiene. Basti pensare all’uso di certi farmaci neurostimolatori prima o dopo una certa età, o a convenzioni internazionali sull’adozione di determinate tecnologie. Ciò che rischia di rimanere in ombra, in questi casi, è che l’artefatto tecnologico esiste, lo abbiamo creato noi, ma non abbiamo approfondito il senso del suo esserci e se sia bene, e come, utilizzarlo”.

Proviamo allora a riflettere sui Big Data. A chi giovano? Che possiamo farcene? Di chi è la proprietà?

BENANTI – “La novità prodotta dai Big Data è che siamo passati da una spiegazione della realtà di tipo casuale: piove perché certe correnti di aria calda incontrano correnti di aria fredda e così via…. a un altro criterio di lettura: piove là dove tutti aprono gli ombrelli. Nel paradigma gnoseologico è una vera rivoluzione, perché basandoci su queste inedite forme di correlazioni di dati prima non disponibili, vengono consentite previsioni senza che se ne sappia il perché e che si cerchi una legge sottostante. Faccio un altro esempio: se dispongo di mole di dati che mi dicono che chi si sveglia tutti i giorni alle 5,30, fa ginnastica e corre, fa la doccia, fa colazione e va al lavoro tutto tonico non si ammala di cancro così frequentemente rispetto a chi si sveglia alle 7,30 e si butta sulla metropolitana ancora assonnato, ho creato dei paradigmi medico-salutisti basati non su scoperte scientifiche, bensì su correlazioni di enormi zettabyte di dati. È un orizzonte interpretativo del tutto nuovo e diverso”.

Grazie ai Big Data si può incrementare esponenzialmente anche l’intelligenza artificiale e le sue molteplici applicazioni. Non ritiene che sia una prospettiva affascinante?

BENANTI – Indubbiamente sì, perché l’avanzata dell’intelligenza artificiale ci prospetta novità importanti, come ad esempio l’auto senza pilota. Gli esperimenti tra Google, Tesla e così via stanno procedendo spediti e entro pochi anni dovrebbero iniziare a circolare le prime vetture ‘intelligenti’. Anche qui però siamo davanti a domande di senso fondamentali: tali vetture saranno basate su processi di machine learning impostati su mole di dati e su talune precauzioni operative. Viste le dinamiche del traffico, la scatola nera della vettura potrebbe essere chiamata a decidere in caso di rischio di incidente se sacrificare la vita del proprio passeggero oppure quella di quattro ragazzini che traversano la strada. Quindi ancora una volta ci si chiede: affiderei la mia vita a un qualcosa che non so a priori come e perché la tutela, oppure no? E chi decide se investire i ragazzini oppure evitarli andando a sbattere contro il muro e rischiare di far morire il passeggero: l’algoritmo del server che controlla l’auto senza pilota o colui che è trasportato? E chi mi spiega i ‘valori’ sui quali tale algoritmo viene impostato?”.

È ipotizzabile che in un futuro non molto lontano pochi detentori di Big Data siano in grado di controllare se non di sostituirsi ai governi e alle istituzioni democratiche, pur rispettandone formalmente la presenza e il ruolo, determinando di fatto le grandi scelte sociali?

BENANTI – “Rispondo con una dato: il 75% del Pil dei paesi del G8 si fonda sull’informazione, ma non abbiamo una definizione filosofica di cosa significhi gestire questa enorme massa di dati. Vaghiamo nel nulla, legando semplicisticamente l’informazione ai dati. Siccome sappiamo che il valore dell’informazione è il suo legame di senso con il dato considerato, la domanda è: l’informazione è nei dati o l’intelligenza la legge nei dati? Faccio un esempio: all’interno del Dna ogni gene ha il proprio compito e significato. Posso trovare tutte le correlazioni che voglio tra questo gene e gli altri. Ma rimane la questione: chi ce lo ha messo e perché?”.

È però innegabile che la scoperta di tali correlazioni sia un grosso passo avanti, non pensa?

BENANTI – “Rispondere che correlazione ci sia tra l’informazione e i dati rappresenta il valore strategico dei dati stessi. Non a caso assistiamo al fatto che grandi corporazioni stanno accumulando dati in maniera che non ha precedenti. È come se il petrolio, al momento della sua scoperta, fosse stato accumulato senza sapere che farne. Si capisce che l’intuizione sui Big Data è che gli stessi diventeranno informazione e anche una preziosa, ineguagliabile informazione. Solo che al momento la semantica non c’è, o è solo all’inizio. In attesa di elaborarne una, intanto c’è chi sta facendo raccolte sistematiche di dati”.

L’utilizzo commerciale dei Big Data ha già mosso passi robusti. Basta pensare alle mail e ai messaggi tematici spediti ai propri utenti da Google e Amazon. Cosa c’è che non va in questa dinamica?

BENANTI – “Ancora una volta ritorna la questione della frontiera e del limite. C’è il petrolio, non sappiamo esattamente che farcene, ma intanto se ne fanno scorte strategiche. Qualche utilizzo comincia ad avere ritorni interessanti. Intuiamo che incrociando i dati di determinate persone o categorie, potremmo scoprire cosa compreranno, come voteranno, quando e come si ammaleranno. Una manna per corporations, politici e per le assicurazioni sanitarie! E ancora, nei processi di selezione del personale, incrociando i dati dei social network dei candidati, senza fare colloqui particolarmente approfonditi, potremmo arrivare a scoprire le tendenze personali, la psiche, gli orientamenti sessuali, politici, economici e quindi decidere se assumere o meno. Tutto questo è lecito? Che cosa è oggi, grazie all’irrompere dei Big Data, la privacy? Perché il dato è come l’impronta personale: il problema da porsi è se si tratti di una proprietà personale, oppure, visto che si trova sui social network, sia un bene disponibile a tutti. A queste domande dobbiamo rispondere sul piano giuridico, se vogliamo resistere alle sfide inedite che la tecnologia solleva a livello globale, altrimenti rischiamo di sconquassare il tessuto sociale”.

Grazie al machine learning fra poco non avremo più bisogno degli interpreti e neanche di imparare nuove lingue, perché un auricolare connesso alla rete ci tradurrà istantaneamente quanto ci sta dicendo un keniota, o un papuasico o un eschimese. Sarà la fine della Torre di Babele?

BENANTI – “Può esserci questo esito, ma la domanda è quanto affidarsi al machine learning. Torna l’esempio di prima dell’auto senza pilota, o del trenino passeggeri automatico dentro gli aeroporti: di fronte al rischio di investimento come si comporteranno questi veicoli ‘intelligenti’? Sacrificheranno o meno i propri passeggeri? Perché il punto riguarda gli interessi che entrano in gioco. La babele non sarà magari più di lingua, ma degli interessi, pur con un indubbio progresso tecnologico che è sempre il benvenuto. Comporre questa babele sarà la sfida del machine learning”.

Il fatto che oggi l’uomo mostri di saper sempre di più conoscere e gestire sia l’infintamente piccolo (nanostrutture della materia), sia l’infinitamente grande (Big Data) non rischia di dare vita a una società autosufficiente, superba e in ultima analisi a-religiosa, in quanto non sente più il bisogno di Dio?

BENANTI – “Il discorso sulle nanotecnologie è particolarmente interessante, perché ci chiede ancora di più che rispetto alle tecnologie tradizionali di aprire la scatola nera che le governa. Il fatto è che andando alla radice della materia rinveniamo dinamiche di auto-assemblamento che ci fanno arrivare quasi a ‘giocare a Dio’. Però questo ‘playing God’ può diventare un gioco pericoloso che può sfuggire di mano al giocatore. E allora ritorna l’esigenza di un modello etico riconosciuto, che non sia basato sulla paura, ma sulla validità di queste scoperte per il bene crescente a disposizione dell’umanità. Si esigerà anche un codice deontologico sovranazionale per la gestione dei Big Data, ma il discorso ci spingerebbe troppo avanti”.

Se i Big Data sembrano destinati a portarci a una inedita forma di “Big Society”, dove i grandi server controlleranno miliardi di uomini tramite miriadi di sensori e contatti informatici, la religione e il suo annuncio dovrà trasformarsi in “Big Religion”? Con quali novità sul piano dell’annuncio e dell’incorporazione del singolo in una Chiesa non più geograficamente circoscritta come è stata, finora, più o meno attorno alla parrocchia?

BENANTI – “È evidente che i Big Data ci daranno un controllo su quello che accade enorme: ad esempio, incrociando i dati di una megalopoli come Los Angeles già oggi in teoria sembra possibile prevedere dove e come si verificheranno certi tipi di crimini. I problemi dell’uomo fin dalla comparsa sulla terra non sono però sul controllo di cosa accade ma sul senso del perché si vive. Di fronte ai crimini la domanda di fondo sarà ancora perché quel tale uomo vuole uccidere? Si apre così uno spazio di ulteriorità e di significato che spostano l’attenzione dalla correlazioni dei dati e dalla loro interpretazione alla correlazione a Dio e alle grandi leggi dell’esistenza. Il vero problema semmai verrebbe il giorno in cui si sostituisse la domanda di senso con una domanda di controllo tecnico. Ma ritengo che l’uomo rimanga fondamentalmente aperto e proiettato verso la trascendenza, piuttosto che schiacciato sulla tecnica”.

Lei ritiene che la Chiesa istituzionale (penso a Santa Sede, Conferenze Episcopali e Diocesi), debba iniziare a pensare a una adozione di sistemi di lettura di Big Data per meglio promuovere la propria presenza nel mondo?

BENANTI – “La Chiesa ha una missione anche educativa, spesso deve supplire sistemi pubblici che non funzionano. Una sfida odierna consiste nell’educare le nuove generazioni a cosa è un dato, a come utilizzarlo o crearlo, a come non essere strumentalizzati dalle nuove tecnologie. Oggi rischiamo che queste ultime lascino tatuaggi digitali indelebili sui giovani, in grado di condizionare il loro futuro. E inoltre abbiamo l’azione propria della Chiesa che è pastorale. Dubito che i Big Data ci dicano a quale porta bussare per portare i sacramenti. Tuttavia è anche vero che questi stessi Big Data potrebbero essere utili a un ordine religioso per salvare le proprie risorse gestendole meglio. Come sempre nella storia dell’umanità, esiste una risposta etica per apportare i mezzi al fine voluto. La Chiesa dovrà vincere la sfida di questi nuovi mezzi accordandoli ai fini che le sono propri. Nei due millenni dell’era cristiana ha finora dimostrato di saperlo fare piuttosto bene”.

Documenti di riferimento

- “Ut si homo non daretur? Un tentativo di dialogo con il post-umano a partire da alcuni spunti della Gaudium et spes” in Gregorianum 97,3(2016), 543-564.

- La condizione tecno-umana. Domande di senso nell’era della tecnologia, Bologna, EDB, 2016.

- “Cyborg. Un essere sovversivo” in Rocca 08(2016), 36-39.

- “L’intelligenza artificiale” in Rocca 07(2016), 29-31.

- “L’avvento del cyborg” in Rocca 06(2016), 29-33.

- “Il pensiero post-umano e trans-umano” in Rocca 05(2016), 36-38.

- “Il cyborg e l’enhancement umano. Alcune tracce per una valutazione etico-teologica”, in Theologica Leoniana 4(2015), 9-31.

- “L’enhancement umano. Da una medicina della salute alla medicina degli stili di vita”, in P Benanti, R. Vinerba, La persona in relazione con la vita. Questioni morali e sociali su malattia e benessere, Cittadella, Assisi, 2015, 53-122.

- “L’altruismo è irrazionale. Algoritmi e calcoli morali: il ruolo (e il limite) della quantificazione nel pensiero occidentale”, Il Regno – Attualità 6(2015), 407-410.

- Francesco Occhetta – Paolo Benanti, “La politica di fronte alle sfide del postumano”, in La Civiltà Cattolica 3954, I (2015), 572-584.

- The cyborg, Corpo e corporeità nell’epoca del postumano, Cittadella, Assisi, 2012.